简介

1986年至1988年,迈克尔·I·乔丹在马萨诸塞大学计算机和信息科学系担任博士后研究员。1988年至1998年,迈克尔·I·乔丹担任麻省理工学院脑与认知科学系 助理教授、副教授、教授。1998年,迈克尔·I·乔丹担任加州大学伯克利分校电子工程和计算机科学系、统计系教授。2015年至2017年,迈克尔·I·乔丹担任加州大学伯克利分校统计系主任。2017年,迈克尔·I·乔丹担任加州大学工业工程与运筹学系教授。2018年,迈克尔·I·乔丹担任北京大学名誉教授。

2009年,迈克尔·I·乔丹获得ACM/AAAI艾伦·纽厄尔奖(美国计算机协会ACM、美国人工智能促进会AAAI )。2015年,迈克尔·I·乔丹获得鲁梅尔哈特奖(国际认知科学学会CSS)。2016年,迈克尔·I·乔丹获得国际人工智能联合会议卓越研究奖(IJCAI) 。后迈克尔·I·乔丹获得约翰·冯·诺依曼奖(电气与电子工程师协会IEEE)、米切尔奖(国际贝叶斯分析学会,ISBA)、乌尔夫·格林纳德随机理论与建模奖(美国数学会, AMS)等。

迈克尔·I·乔丹的突出贡献在于成功连接计算机科学和统计学这两个学科,包括统计推理和学习的变分方法、基于图模型和贝叶斯非参数化的推理方法,以及统计风险和计算复杂性之间的权衡特征。同时开发了基于梯度的优化和抽样的连续时间模型,及其用于优化工作的分布式系统。截至2023年10月,迈克尔·I·乔丹指导80多名博士生和60多名博士后研究人员,他的学生目前活跃在世界领先的学术机构,带领行业向前发展。

人物经历

教育经历

1985年,迈克尔·I·乔丹出生。1978年,迈克尔·I·乔丹取得路易斯安那州立大学心理学学士学位。1980年,迈克尔·I·乔丹取得亚利桑那州立大学数学硕士学位。1985年,迈克尔·I·乔丹毕业于加州大学圣地亚哥分校认知科学专业毕业。1986年至1988年,迈克尔·I·乔丹在马萨诸塞大学计算机和信息科学系担任博士后研究员。

工作经历

1988年至1998年,迈克尔·I·乔丹担任麻省理工学院脑与认知科学系 助理教授、副教授、教授。1998年起,迈克尔·I·乔丹担任加州大学伯克利分校电子工程和计算机科学系、统计系教授(截至2023年10月)。2015年至2017年,迈克尔·I·乔丹担任加州大学伯克利分校统计系主任。2017年起,迈克尔·I·乔丹担任加州大学工业工程与运筹学系教授(截至2023年10月)。2018年起,迈克尔·I·乔丹担任北京大学名誉教授(截至2023年10月)。2017年10月25日至27日,以“智能科学的发展与应用”为主题的第二届智能科学国际会议在上海海事大学召开。迈克尔·I·乔丹参加,迈克尔·I·乔丹预测从2017年起未来十年之内,人工智能系统的智能还非常有限,这些AI系统还不能像人类这样具有极高的灵活性和创造性。

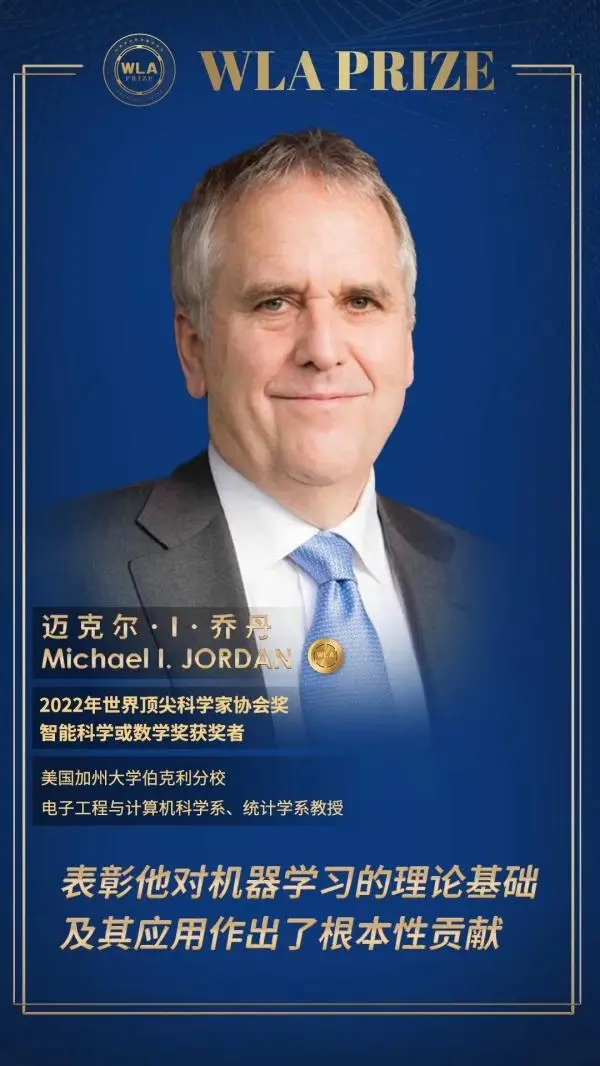

2019年起,迈克尔·I·乔丹担任清华大学名誉教授(截至2023年10月)。2022年11月6日,迈克尔·I·乔丹成为首届世界顶尖科学家协会奖“智能科学或数学奖”的获得者,应邀来到上海出席第五届世界顶尖科学家论坛同时参与首届世界顶尖科学家协会奖颁奖典礼。2023年,迈克尔·I·乔丹担任顶科协奖遴选委员会主席。9月4日,迈克尔·I·乔丹参加2023INCLUSION·外滩大会,就AI的本质以及未来发展方向进行了深度的剖析和解读。

社会职务

时间 | 担任 |

1991年 | 美国国家科学基金会主席青年研究员(PYI) |

2002年 | 人工智能促进协会(AAAI)研究员 |

2004年 | 国际数理统计学会勋章讲座讲师 |

2005年 | 电气与电子工程师协会(IEEE)研究员 |

2005年 | 数学统计研究所研究员 |

2007年 | 美国统计协会(ASA)研究员 |

2010年 | 美国国家科学院院士 |

2010年 | 美国国家工程院院士 |

2010年 | 计算机机械协会(ACM)研究员 |

2010年 | 美国国家工程院(NAE)成员 |

2010年 | 美国艺术与科学学会会员 |

2010年 | 认知科学学会(CSS)研究员 |

2010年 | 美国国家科学院(NAS)成员 |

2011年 | 美国科学促进会(AAAS)研究员 |

2011年 | 美国人文与科学院院士(注:American Academy of Arts and Sciences又译为“美国艺术与科学院”) |

2012年 | 工业与应用数学学会(SIAM)研究员 |

2014年 | 国际贝叶斯分析学会(ISBA)研究员 |

2020年 | 耶鲁大学荣誉博士 |

2021年 | 英国皇家学会外籍会员 |

2022年 | 国际数理统计学会首届格雷丝·沃赫拜讲座讲师 |

2023年 | 2023年顶科协奖遴选委员会主席 |

以上信息参考:

主要论文与研究方向

论文

论文标题 | 发表时间 | 发表期刊报纸 | 共同合作 |

《Hierarchical mixtures of experts and the EM algorithm》 | 1994年3月 | Neural Computation, vol. 6, no. 2, pp. 181-214 | R. A. Jacobs |

《An internal forward model for sensorimotor integration》 | 1995年9月 | Science, vol. 269, pp. 1880-1882 | D. Wolpert、 Z. Ghahramani |

《An introduction to variational methods for graphical models》 | 1999年11月 | Machine Learning, vol. 37, no. 2, pp. 183-233 | Z. Ghahramani、 T. S. Jaakkola、 L. K. Saul |

《Latent Dirichlet allocation》 | 2003年1月 | J. Machine Learning Research, vol. 3, pp. 993-1022 | D. M. Blei、 A. Y. Ng |

《Graphical models》 | 2004年2月 | Statistical Science: Special Issue on Bayesian Statistics, vol. 19, no. 1, pp. 140-155 | —— |

《Hierarchical Dirichlet processes》 | 2006年12月 | J. American Statistical Association, vol. 101, no. 476, pp. 1566-1581 | Y. W. Teh、M. J. Beal、 D. M. Blei |

《Learning spectral clustering, with application to speech separation》 | 2006年12月 | J. Machine Learning Research, vol. 7, pp. 1963-2001 | F. R. Bach |

《Structured prediction, dual extragradient and Bregman projections》 | 2006年12月 | J. Machine Learning Research, vol. 7, pp. 1627-1653 | B. Taskar、S. Lacoste Julien |

《Optimistic concurrency control for distributed unsupervised learning》 | 2013年 | Advances in Neural Information Processing Systems 26, 2013, pp. 1403--1411 | X. Pan、J. E. Gonzalez、 S. Jegelka、T. Broderick, |

《Parallel correlation clustering on big graphs》 | 2015年 | Advances in Neural Information Processing Systems 28, 2015, pp. 82--90 | X. Pan、D. Papailiopoulos、 S. Omyak、 B. Recht、 K. Ramchandran |

《"Gradient Descent Only Converges to Minimizers," in Proceedings of the 29th Conference on Learning Theory》 | 2016年 | New York, USA, June 23-26, 2016, 2016, pp. 1246--1257 | J. D. Lee、 B. Recht、 M. Simchowitz |

《Learning strategies in decentralized matching markets under uncertain preferences》 | 2021年3月 | Journal of Machine Learning Research, vol. 22, pp. 1-50 | X. Dai |

《High-order Langevin diffusion yields an accelerated MCMC algorithm》 | 2021年3月 | Journal of Machine Learning Research, vol. 22, pp. 1-48 | W. Mou、 M. Yi-An,、M. Wainwright,、P. Bartlett |

《Optimization with momentum: Dynamical, control-theoretic, and symplectic perspectives》 | 2021年7月 | Journal of Machine Learning Research, vol. 22, pp. 1-50 | M. Muehlbach |

《Fundamental limits of detection in the spiked Wigner model》 | 2021年7月 | Annals of Statistics, vol. 48, pp. 863-885 | A. El Alaoui、F. Krzakala |

《Interleaving computational and inferential thinking: Data science for undergraduates at Berkeley》 | 2021年9月 | Harvard Data Science Review, vol. 2, pp. 1-24 | A. Adhikari、J. DeNero |

《Learning equilibria in matching markets from bandit feedback》 | 2021年 | Advances in Neural Information Processing Systems | M. Jagadeesan、A. Wei |

《Understanding the acceleration phenomenon via high-resolution differential》 | 2022年4月 | Mathematical Programming, vol. 5, pp. 634-648 | B. Shi、S. Du、W. Su |

以上信息参考:

研究方向

主要研究方向为人工智能、生物系统与计算生物学、控制、智能系统和机器人、信号处理、机器学习等。

主要成就

学术成就

近四十年来(截至2022年),迈克尔·I·乔丹一直是全球领先的统计机器学习领域的研究人员。 他的突出贡献在于成功连接了计算机科学和统计学(这两个学科),包括统计推理和学习的变分方法、基于图模型和贝叶斯非参数化的推理方法,以及统计风险和计算复杂性之间的权衡特征。同时迈克尔·I·乔丹研究优化和机器学习的交叉领域,开发了基于梯度的优化和抽样的连续时间模型,和用于优化工作的分布式系统。迈克尔·I·乔丹还构建了机器学习和控制理论间的关联研究,为强化学习理论、基于学习的模型预测控制和人类运动控制的最优化原理做出了贡献。迈克尔·I·乔丹率先将微观经济概念与机器学习相结合,开发了激励学习者分享数据的学习方法,并展示了如何将契约理论用于统计推理,为基于学习的匹配市场研究做出贡献。后致力于推动机器学习在单分子成像、蛋白质建模、基因重组建模和自然语言处理等高影响力领域的应用。

教育成就

截至2023年10月,迈克尔·I·乔丹指导80多名博士生和60多名博士后研究人员,他的学生目前活跃在世界领先的学术机构,带领行业向前发展。

所获荣誉

Diane S.McEntyre · 计算机科学卓越教学奖(Diane S. McEntyre Award for Excellence in Teaching Computer Science)获奖2006年CIS · 神经网络先锋奖(CIS Neural Networks Pioneer Award)获奖2007年SIAM · 活动组优化奖(SIAM Activity Group Optimization Prize)获奖2008年ACM-AAAI · 艾伦·纽厄尔奖(ACM-AAAI Allen Newell Award)获奖2009年国际认知科学学会CSS · 鲁梅尔哈特奖获奖2015年—— · 大卫鲁姆哈特奖(David E.Rumelhart)获奖2015年展开人物评价

迈克尔·I·乔丹教授是机器学习领域的先驱,为机器学习、概率学、统计学以及图形建模四者间建立了联系,这些领域的相互联系不仅促进了机器学习领域的研究和发展,还提升了相关领域研究工作的质量和数量。(”顶科协奖“智能科学或数学奖”遴选委员主席、2017图灵奖得主约翰·轩尼诗评)

迈克尔·I·乔丹的人格魅力令他深深折服。他对学生能 “因材施教”,曾被戏称为“会看相”。他的不少学生觉得,有这样一位既会周到考虑学生职业发展,又不会有“一日为师,终生为父”负担的导师,实在是人生幸事。(北京大学人工智能研究院张志华教授评)